输入指令:猫,困惑,故障艺术,一副创意作品就这样产生,用时不到30秒。

这正是全球爆火的AI作画。利用AI绘画工具,你只需输入不同的词汇,例如不同的艺术家风格、构图、色彩、透视方法以及修饰词,就能快速得到符合词汇主题的画作。你可以充分发挥自己的想象力,而任何一个关键词的变动都可能产生完全不一样的结果。

AI绘画的爆火,贴合了人们亲近艺术的追求。绘画创作原本是小众的专长,多数人只能望而赞叹。现如今只需提供几张画作参考,并输入个性化词条,每个人都能拥有自己的作品。你可以大胆地将一束花变为美少女,抑或是将梦中模糊的光景记录下来。AI绘画降低了构图作画的门槛,让更多的人能够体验艺术创作的乐趣。

AI绘画作品流入市场,一定程度上改变了业态。圈内流传着一则玩笑:“7月份,某画师还在鄙视AI作品,9月份就已经被抢走生意。”这反映出AI进步之快与适应能力之强。现如今,AI能够为画师提供底稿,精简艺术创作流程,或是直接为快消宣传供稿。可以预见,成熟的AI绘画在大数据的支持下能够紧跟市场导向,戳中多数人的审美点。

在Disco Diffusion上使用不同艺术家风格基于同样两句描述语所生成的不同风格AI画作

实际上,AI作画这项技术并不新鲜,但是文字转图片这种形式将创作门槛拉到了足够低,得以让很多人体验用AI进行艺术创作。

社交媒体上,抱着猎奇心态的用户惊讶于AI在绘画领域已经实现的惊人创造力,但在另一面,人类对AI的焦虑感再度爆发。

2022年8月,美国科罗拉多州博览会的一项艺术比赛中,一位游戏设计师用AI绘画工具midjourney创作了一幅《太空歌剧院》画像,并获得了艺术比赛第一名。该消息引发了画师群体对于人工智能创作的剧烈讨伐:人工智能能否正义地利用画师的成果进行模型训练?与人类在绘画上同台竞技是否公平?是否会对画师职业形成巨大挑战?

不安的情绪还蔓延至其他领域。一个月后,一位学生沮丧地声称OpenAI GPT-3模型替自己撰写的论文获得了全A成绩,帖子发表后快速登上推特热搜,众多教授开始表达对于人工智能论文的担忧。GPT-3模型能够支持用户仅仅输入一些关键词句指令,帮助输出任意一篇诗歌、散文、新闻报道和创意小说。

过去很长一段时间,人类对AI的想象建立在有足够安全感的基础上,因为受技术所限,AI在创造力上几乎没有什么真正意义上的进展,更多地在替代人类从事那些可重复性高的“dirty work”。

但现在,一切正在改变。

AIGC解锁新世界

2018年,一副由人工智能生成的肖像画在佳士得被拍出了43.25万美元,成为世界上首个出售的人工智能艺术品。

《Edmond de Belamy》

画面中的男人面目模糊,身穿黑色袍子,有着浓厚的中世纪风格。右下角的作者署名区,显示着一行数学公式,以告知人们这是人工智能所作。

为了“画出”这件作品,它的创造者Obvious组织成员利用了一个名为“生成性对抗网络”(Generative Adversarial Network,GAN)的模型,用1.5万个十四世纪至二十世纪之间的肖像画数据对模型进行了投喂,直到产出的图片通过图灵测试。

这幅画的拍卖在当时引发了众多关注。Obvious组织趁势提出了一个直击人心的口号:“创造力不仅属于人类”。它们想要证明, AI也能成为一等的艺术家。

AI作画是AIGC(Artificial Intelligence Generated Content)里面的一个分支,指的是一种通过AI技术来自动或辅助生成内容的生产方式。通过输入指令,人类让AI去完成冗杂的代码、绘图、建模等任务,从而生成内容。

除了AI绘画,如今的AI还可以解锁写诗、作曲、换脸、捏脸等等需要创造力的工作。

今年9月,Meta公司推出了Make-A-Video人工智能系统,它可以利用几个关键词或几行文字描述生成一个几秒钟的短视频,甚至还能通过给定的视频或图像,来制作视频。

10月,在一档人工智能博客节目中,已故的苹果创始人乔布斯竟然成为首位嘉宾,与美国知名播客主持人Joe Rogan进行了一场长达20分钟的交流,讨论了乔布斯对大学、计算机的看法以及工作状态、信仰等。这档名为podcast.ai的节目将乔布斯的传记和网络上的录音,用Play.ht模型进行大量训练,最终产生出与乔布斯对谈的内容。

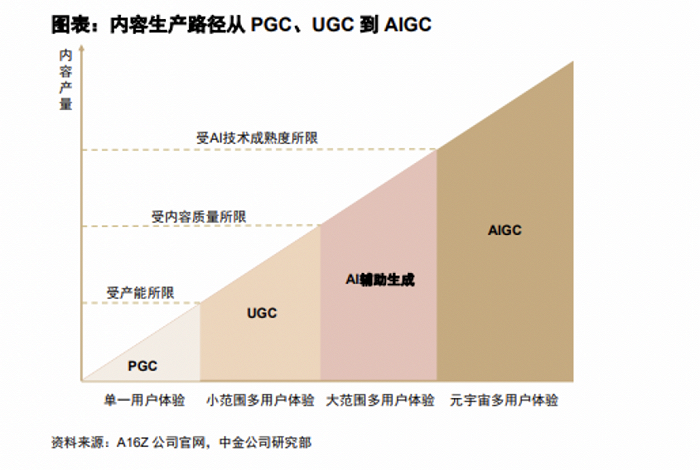

继专业生成内容(Professional Generated Content,PGC)和用户生成内容(User Generated Content,UGC)之后,AIGC正在成为一种新型生产方式。

9月举办的2022万象·百度移动生态大会上,百度发布了一组“AI打工天团”,覆盖了各种AIGC应用,包括AI自动生成文字、图片,图片转换成视频。百度称,这个团队里不仅有文案、插画师,还有视频制作人,熬夜加班的活儿都可以交给AI。

更早之前,海外微软“小冰”的音乐已经实现旋律、编曲及歌词端一体化;2019年,中国平安AI作曲在世界AI作曲国际大奖赛中获得第一,创作AI交响变奏曲《我和我的祖国》;今年年初,网易利用AI系统成功制作出两首国风作品《耀染先农》和《春启正阳》。

红杉美国的两位合伙人在一篇题为《Generative AI: A Creative New World》的报告中表示,机器开始尝试创造有意义和美丽的东西,这个新类别被称为“生成式AI(Generative AI)”,这意味着机器正在生成新的东西,而不是分析已经存在的东西。

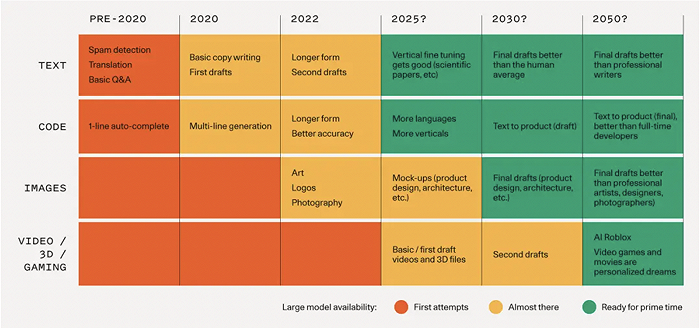

图源:《Generative AI: A Creative New World》

这份报告中显示,从2020年到2025年,AI生成的技术将会不断成熟,逐步可以生成文字、图片、语音、代码、视频以及游戏模型等等,而社交媒体、设计、游戏、代码生成等行业将迎来革新性改变。

AI作画为何突然爆火?

AI作画的热潮已经显现在资本市场。

2022年上半年开始,加入AI作画赛道的厂商越来越多。在国外,半年内涌现出Stable Diffusion、Disco Diffusion、DALL-E2、Mid Journey、Photosonic AI多家AI作画公司。国内,Tiamat、蜜度、百度文心、6Open等一批公司开始对外推出相关产品。

它们的迭代速度非常之快。“今年5月之前,AI所能生成的还是几乎没有商业价值的图片,但现在已经进入准商用级别了。”Tiamat创始人青柑告诉界面新闻记者,在早期研发特色管线的过程中,需要对数据、反馈系统进行不断调整,但是跑通一个管线之后,就会快速迭代,根据不同商业化场景进行管线定制。

这使得该赛道迅速成为资本圈的新宠。10月18日,上线仅两个月的AI作画平台StableDiffusion,产出作品超过200万张,其背后公司StabilityAI获得新一轮1.01亿美元融资,公司估值突破10亿美元,成为新晋独角兽企业。10月,国内AIGC初创公司Tiamat宣布获得来自DCM的数百万美元天使轮。

AI展现绘画、写诗等技能,本质上属于自然语言生成Natural Language Generation(NLG)的应用,是NLP自然语言处理技术的一大类任务,已经应用了将近30年。

但用Tiamat创始人青柑的话说,过去对AI的运用“更多像是学术界的自嗨”。而今年AI创作的技术因为一种呈现为文字转图像(Text-to-image)特性的崭新交互方式,允许大众开始参与自主创作,不仅仅停留在实验室和科技展会中的Demo。

多位AI作画厂商向界面新闻记者分析,AI作画能够快速成为低门槛的产品背后,主要是底层模型技术的革新。

传统AI绘画的的技术原理是生成对抗网络(GAN)或VAE等。而GAN作为上一代AI绘画工具与平台最主流的图像生成模型,在模型训练方面已经有了很大的突破,但在实际应用的过程中仍然拥有严重的结构性问题,比如当用户希望生成“眼睛长在鼻子下面的人脸”,或“戴着用鲜花构成的眼镜”这种域外(Out-Of-Domain)的结果时,GAN通常会失效。

而在操作上,这类模型一般由用户提供草图,由GAN模型将其转化为真实的风景图像,用户无法通过文本影响生成结果。

直到CLIP与Diffusion模型开始出现并相互结合,文字直接生成可以商业落地的图像才成为可能。

Diffusion指的是一种去躁扩散模型,其工作原理就是先给一幅画面逐步加入噪点,一直到整个画面都变成白噪声,再记录这个过程,然后逆转过来给AI学习。而AI所看到的是全是噪点的画面如何一点点变清晰直到变成一幅画,通过学习这个逐步去噪点的过程来学会作画。

由于Diffusion适用于具有大量不同和复杂数据的学习模型,从而解决了GAN的问题,因此,Diffusion对图像生成效果的提升十分显著,数字生成的痕迹也得到了有效削弱,用户自己可选执行步数,步数越多图像越精细的特点也激起了更多的“硬核”需求。

CLIP是一种跨模态的图文,这个模型的使用可以允许用户通过文字的形式实现AI作画。它的原理是使用已经标注好的“文字-图像”训练数据,一方面对文字进行模型训练,同时对图像进行另一个模型的训练,不断调整两个模型内部参数,使得文字特征值和图像特征值能让对应的“文字-图像”确认匹配。

“因为底层技术的突飞猛进,AI绘画输出的画面在这短短的半年内,从最初的较为粗糙快速迈入了准商用的高完成度。” AI数据智能应用公司蜜度CTO刘益东告诉界面新闻记者。前不久,基于自研的自然语言处理和图像生成技术,这家企业刚刚推出了自己的AI作画应用“蜜小度”,并且正在积极筹备2.0的商用版本。

不仅如此,技术的进步让AI绘画开始逐渐具备艺术性。“过去学术界评价标准是我所生成的图像与文本含义有多接近,而不是作品本身有多少艺术价值。” Tiamat创始人青柑称。

除了模型层面的突破,推动AI作画发展的还有数据和算力层面的快速进步。刘益东表示,过去的AI作画训练中一直缺乏相应的训练数据集,要训练AI必须要有千万级规模的高质量“图文对”(image-text pair),让AI在大脑中能够将文字与图片的意思进行匹配连接。而近年来,由于大量创作者的加入和互联网的发展,互联网中可训练的数据集变得更加丰富。

在上文提到红杉的报告中,红杉的两位合伙人认为,由于Diffusion Models的应用以及算力成本的下降,生成式AI已经变得更好、更快、更便宜。接下来,“杀手级应用该出现了”。

AIGC的商业空间

在商业上,AIGC的巨大想象力主要集中在内容创作与元宇宙当中。

在内容创作领域,生成式AI被寄予厚望。百度创始人李彦宏表示,AIGC是PGC、UGC之后,全新的内容生产方式。它不仅会提升内容生产的效率,也会创造出有独特价值和独立视角的内容。

虽然众多AI作画厂商仍处在快速迭代产品的测试期,商业化模式非常早期。但是对于部分B端客户来说,AI作画的吸引力十分之大。

在没有任何BD的情况下,不到半年时间,Tiamat已有数十家B端客户,并与知名科幻IP、央视网以及《时尚芭莎》、《嘉人》等一线时尚大刊建立长期合作关系,与众多头部游戏公司,特别是与持有故宫文化相关IP的非遗文化IP机构知造局等开展了战略合作。

当然,更有想象空间的商业化场景在于元宇宙,这也是AIGC被资本热捧的重要原因。元宇宙中需要建设生成大量的建筑、场景、人物等等各种虚拟资产,对于这部分工作,AI是最适合的完成者。

比如,RCT Studio打造的Morpheus引擎能够通过深度学习,输入目标文字即可渲染成3D资源和动画,这被视为通过AI在元宇宙中低成本构建小型场景初具技术基础的信号。以及,众多虚拟人公司利用AI生成数字人化身、驱动数字人的面部表情变化,AI驱动的数字人化身逐渐成为现实。

在现实生活中,生成式AI在医疗保健、数字商业、制造业、农业等多个行业都有丰富的应用前景,如帮助医生检测X射线、CT等设备扫描中的病变、辅助检测产品质量等等。

不过,AIGC整体仍处于早期阶段,生成式AI仍有很多问题需要解决。

以发展最快的AI作画行业来看,首先需要解决的是版权问题。训练AI需要大量的图文对数据,AI创作的画作会包含这些可能产生版权纠纷的元素,这限制了AI作画在商业化方面的进一步发展。一位游戏制作人对界面新闻表示,版权风险是他坚决不考虑用AI作画的原因之一。

一项抽样分析显示,国外最受欢迎的AI作画平台之一Stable Diffusion模型学习了超过50亿条图文对数据,而它所用到的数据集里,大量图片来自Pinterest、Flickr等UGC内容平台,以及Getty等商业图库网站。

Midjourney创始人David Holz在接受采访时曾表示,Midjourney现在的训练数据基本上都是来自于互联网所有能得到的数据、文本和图像。但他本人也不太清楚这些被拿来训练AI的数据是否有版权保护。

因此,许多画师正在抗议自己遭受到了AI的抄袭,并要求退出AI的训练。不过,这些纠纷目前并没有明确的法律依据支持,AI作画仍处在一个灰色地带。

为了最大程度避免潜在的版权纠纷,部分AI作画公司正在积极探索解决方案。Tiamat创始人青柑介绍称,目前Tiamat的做法是首先在训练层进行规避,在数据集中清洗掉大量有版权以及带有明显IP的素材;同时,对于可能存在的版权风险,在产生的画作结果当中对用户进行风险提示。之后,Tiamat希望能够跟一些画师或者艺术家直接合作,让他们来上传自己可以被利用来训练的数据,之后再通过分成或者直接购买的形式来购买一项类似于“AI训练使用权”的权益,从而解决一些当代艺术家的问题。

多位业内人士表示,当下AI作画的发展速度太快,在AIGC的知识产权层面,应当需要业界、学界和相关政策部门共同去探讨,寻找比较好的解决方案。

AIGC在底层的关键性技术仍需摸索。信通院2022年发布的《人工智能生成内容(AIGC) 白皮书 》指出,当前AIGC关键技术不够成熟。人工智能算法在透明度、鲁棒性、偏见与歧视方面存在尚未克服的技术局限,导致算法应用问题重重。此外,在音频、视频、图片、文字等形式的内容编辑与创作技术方面存在机械性问题,离流畅、拟人的感性表现仍有距离。

红杉在报告中写道,“生成式AI应用的第一波浪潮类似于iPhone刚出现时的移动应用场景——有些噱头但比较单薄,竞争差异化和商业模式不明确。然而,其中一些应用程序提供了一个有趣的视角,让我们可以一窥未来可能会发生什么。”

报告中的另一段话则更好的为生成式AI应用的未来做了注解:

生成式AI将深深融入我们的工作、创作和娱乐方式,例如备忘录可以自己写,3D打印任何你能想象的东西,从文字到皮克斯电影,像Roblox类似的游戏体验来快速创造出丰富的世界。虽然这些在今天看起来像是科幻小说,但科技进步的速度是惊人的。从微小(narrow)的语言模型到代码自动生成只用了几年时间,如果我们继续沿着这个变化的速度,并遵循“大模型摩尔定律(Large Model Moore’s Law)”,那么这些遥不可及的场景就会变得触手可及。